Naver,韩国最大的搜索引擎和科技巨头,是韩国数字生活的核心。从电子商务到数字支付、博客和新闻消息,它在多个领域拥有庞大的用户群体与数据。可以说,在韩国,真正的流量入口不是 Amazon,而是Naver。

如果你想稳定、规模化获取 Naver 商店数据,就必须用更系统的方法。本文将带你拆解实战策略,帮助你在合规前提下,快速以最小成本抓取Naver平台的数据,以更好的做出决策。

如果你做的是韩国跨境市场,但数据来源仍停留在 Google、Amazon 或全球工具,那么你看到的只是“外围信息”,而不是本地真实消费信号。抓取 Naver,本质上是获取韩国本土数据语境。在韩国,Naver是:

- 电商平台入口

- 内容分发中心

- 博客与社区聚合平台

- 新闻平台

- 本地品牌认知形成的核心阵地

通过抓取 Naver 的搜索结果、商品信息、博客、论坛和新闻内容,能帮助卖家:

- 识别韩文关键词排名:更好的优化独立站和电商平台的 SEO 布局

- 分析竞品定价、销量与促销策略:调整产品组合和营销方案

- 挖掘用户评论和论坛讨论:发现消费者偏好、痛点与趋势变化

换句话说,Naver 数据抓取不仅能支撑选品、定价和推广策略,更能让跨境卖家在竞争激烈的韩国市场中保持优势。

Naver将内容组织成多个专门板块,每个板块都有独特的 URL 模式和 DOM 结构,抓取的时候需要提前想清楚。主要板块包括:

- 搜索结果:

Naver的核心搜索功能返回网页、图片、视频以及平台自有内容块。与 Google 不同,在搜索结果中高度整合自己的生态系统,卖家可以通过抓取搜索结果直接获取竞品信息、关键词排名和流量趋势。 - 新闻版块:

汇集数百家韩国新闻媒体的文章,并实时更新。对跨境卖家而言,新闻板块是监测品牌曝光、市场动态和行业趋势的重要来源。通过抓取新闻内容,可以快速了解市场舆情和消费者关注热点。 - 博客平台:

韩国用户活跃的博客平台,内容涵盖个人经验分享、产品评价和专业知识。博客数据对于分析消费者偏好、发现痛点和洞察潜在趋势非常有价值。

在抓取数据之前,必须提前规划抓取策略,明确要获取的内容类型以及对应的解析方法,才能高效提取有价值的数据。

步骤二:准备技术环境

Naver 页面结构复杂,同时包含大量韩文内容,因此对请求稳定性和解析能力都有一定要求,需要先搭建一个基础的Python抓取环境。

1. 安装常用的抓取依赖库:

pip install requests beautifulsoup4 lxml urllib3这些库分别承担不同职责:

- BeautifulSoup:解析 HTML 页面结构

- lxml:提高解析效率与稳定性

- urllib.parse:处理韩文关键词的 URL 编码

2. 导入基础模块

import requests

from bs4 import BeautifulSoup

import urllib.parse

import time

import random

from typing import Dict, List, Optional3. 韩文文本与编码预处理

虽然 Python 3.x 默认支持 Unicode,但在抓取 Naver 时仍需注意:

- 零宽字符

- HTML 实体编码

- BOM 字符

- URL 编码与解码问题

如果不提前处理这些问题,后续数据存储、关键词匹配和情感分析都会受到影响。

4. 风控与访问节奏控制

跨境卖家在批量抓取时,不要忽略请求节奏与IP风控,Naver会根据异常访问行为限制访问。建议使用适合的动态IP或人为操作随机请求间隔来进行访问轮换。

1.创建会话

Naver 会根据请求头、语言偏好、连接方式等判断访问来源。如果直接使用默认请求配置,极易被识别为异常流量。因此,我们需要模拟一个“真实的韩国浏览器环境”。

import requests

def create_naver_session() -> requests.Session:

"""Create a requests session optimized for Naver scraping."""

session = requests.Session()

# Headers that mimic a Korean browser user

session.headers.update({

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 "

"(KHTML, like Gecko) Chrome/119.0.0.0 Safari/537.36",

"Accept": "text/html,application/xhtml+xml,application/xml;q=0.9,image/webp,*/*;q=0.8",

"Accept-Language": "ko-KR,ko;q=0.9,en;q=0.8",

"Accept-Encoding": "gzip, deflate, br",

"Connection": "keep-alive",

"Upgrade-Insecure-Requests": "1",

"Cache-Control": "max-age=0",

})

return session这一步的关键点有两个:

- Accept-Language设置为韩语优先,确保返回完整的韩文本地内容

- 使用常见浏览器的 User-Agent,避免被识别为脚本程序

2. 营造安全环境

为了提高稳定性,我们还需要一个带重试逻辑的页面请求函数:

import time

import random

from typing import Optional

def get_page_safely(session: requests.Session, url: str, max_retries: int = 3) -> Optional[str]:

"""Fetch a page with retry logic and proper error handling."""

for attempt in range(max_retries):

try:

# Random delay to avoid appearing bot-like

time.sleep(random.uniform(1, 3))

response = session.get(url, timeout=30)

if response.status_code == 200:

# Ensure proper encoding for Korean text

response.encoding = response.apparent_encoding or 'utf-8'

return response.text

elif response.status_code in (403, 429):

print(f"Blocked by Naver (status {response.status_code})")

return None

elif response.status_code == 404:

print(f"Page not found: {url}")

return None

except requests.RequestException as e:

print(f"Request failed (attempt {attempt + 1}): {e}")

if attempt < max_retries - 1:

time.sleep(random.uniform(2, 5))

return None1.构建搜索链接

把关键词做韩文编码,分页用 start=1,11,21… 这种规则。

2.请求页面

用前面做好的 session 访问搜索地址。

3.解析结果

从每个搜索块里提取:

- 标题

- 链接

- 描述

- 源网站

步骤五:文本处理

1.清洗韩文文本

- 去多余空格

- 去特殊字符

- 防止乱码

2. 统一数据结构

所有结果都转成统一格式(字典/JSON),方便存数据库或分析。

3. 批量关键词搜索

- 循环多个关键词

- 每个关键词抓搜索 + 新闻

- 中间加延迟,避免频率过高

4. 结果汇总

按关键词分类保存,统计总条数。

1. 建立稳定的会话机制

高成功率的核心在于“像真实用户一样访问”。Naver 会根据访问路径、停留时间、页面跳转逻辑来判断是否为异常流量。如果每次请求都是孤立行为,系统很快会识别异常。

优化方向:

- 使用持久化会话

- 模拟真实浏览顺序(搜索 → 点击 → 翻页)

- 保持合理的页面停留时间

2. 合理控制请求节奏

短时间内大量请求极易触发 429 限速或 403 拒绝访问。相比暴力抓取,更科学的方式是:

- 设置随机延迟

- 控制 IP 请求频率

- 分批次执行任务

- 使用高质量动态 IP 提升稳定性

IP 是影响成功率的关键因素之一。Naver会分析IP 的地理位置、历史行为和访问模式。如果频繁使用同一 IP 或使用异常数据中心IP,很容易被识别。

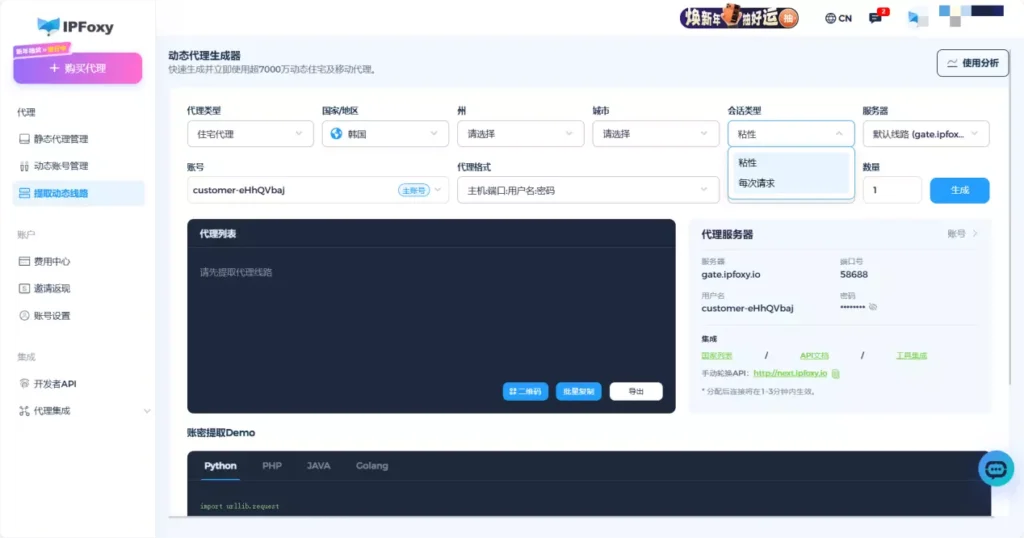

在数据抓取中,通常会接入动态住宅 IP 进行轮换,以降低单 IP 暴露风险。IPFoxy提供的的动态IP代理服务,可以通过API调用和Demo代码接入两种方式应用于数据爬取中,

以下为IPFoxy提供的Python抓取Demo示例:

import urllib.request

if __name__ == '__main__':

proxy = urllib.request.ProxyHandler({'https': 'username:password@gate-us-ipfoxy.io:58688'})

opener = urllib.request.build_opener(proxy,urllib.request.HTTPHandler)

urllib.request.install_opener(opener)

content = urllib.request.urlopen('http://www.ip-api.com/json').read()

print(content)

通过动态代理控制面板,可以生成韩国动态住宅/移动IP,支持按请求或按时间自动切换出口 IP。在批量抓取场景下,这种方式更利于维持访问稳定性,同时减少风控触发概率。

常见原因有三种:页面内容由 JavaScript 动态加载、请求头未正确模拟本地浏览器、页面存在延迟加载或分页机。解决思路是一,检查是否遗漏异步加载内容;二,确保语言优先为韩语;三,验证分页参数规则。

Naver会基于行为模型进行识别,而不仅仅是看访问次数。你有可能是使用固定 IP 长时间高频访问、无会话连续性、无页面停留行为。建议控制IP请求频率、设置随机访问间隔、模拟真实浏览行为、使用动态住宅 IP 轮换等操作来避免风控。

当关键词数量超过 100 个时,问题就从“能不能抓”变成“如何稳定高效抓”。这里建议策略是可以关键词分批执行、设置任务队列、不同关键词分配不同 IP、并结合动态 IP 轮换机制,来提高抓取效率。

结语

在韩国市场,Naver是流量入口,也是消费趋势的风向标。随着电商规模持续扩大,谁能更早获取本地真实数据,谁就更具竞争优势。稳定抓取Naver商店与内容数据,不只是技术动作,更是市场决策能力的体现。提前布局数据能力,才能在韩国电商竞争中占据主动。